はじめに

こんにちは。CTO室長の浅野[@masakz5]です。

近年、AIで生成したフェイク画像やフェイク動画を利用し、事実と異なる事象をあたかも事実であるかのようにSNSで拡散する事件が多発しています。

その目的は、単にインプレッションを稼ぐことにとどまらず、選挙や紛争において政治的な意図を持って利用されることもあります。

AIの性能が向上するにつれて、生成される画像の質も向上しており、フェイクか本物かを見分けることがますます難しくなっています。

このような状況に鑑み、フェイク画像や動画を検出するためのさまざまな取り組みが進められていますが、その一つがこの記事で紹介するC2PAです。

C2PAとは

C2PAは”Coalition for Content Provenance and Authenticity”(コンテンツの来歴と信頼性に関する連合)の略で、Charter(憲章)の冒頭で以下のように宣言しています。

「情報共有のデジタル化に伴い、メディアの来歴を追跡する能力が重要になってきています。

パブリッシャー、クリエーター、消費者のスケールでこの問題に対処するために、当コンソーシアムはコンテンツの来歴と信頼性を確立するための技術仕様を策定します。」

このように、コンテンツの来歴(どのように作られ、どのように編集されたか)を確実に記録し、誰もが検証できるようにすることを目的として作られた団体です。

元々はAdobe、Microsoft、Intelなどが中心となって結成されましたが、現在のステアリングコミッティーには、Amazon、OpenAI、BBC、Google、Meta、SONYなども参加しています(2024年12月現在)。

C2PAと関連団体

C2PAと連携している関連団体として、以下の2つがあります。

- Content Authenticity Initiative (CAI) [1]

Adobeが主導する団体で、C2PAが策定した技術仕様に基づいたシステム実装にフォーカスしています。オープンソースのツールやライブラリを公開しています。 -

Project Origin [2]

MicrosoftとBBCが主導する団体で、主に報道におけるフェイク情報への対応を協議しています。

C2PAの技術仕様

C2PAが策定する技術仕様には、主に2種類のものがあります:

- メインの仕様である「Content Credentials」

- 対象ソフトウェア・ハードウェアの安全性に関する「Attestations」

今回は「Content Credentials」の執筆時点での最新バージョンである2.1に基づいて解説します。

来歴の記録方法

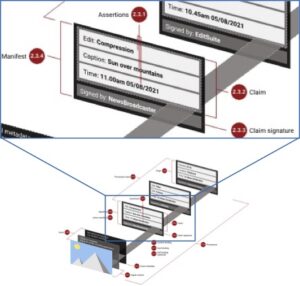

以下の図は、メディアファイル上でどのように来歴が記録されるかを示したものです。(クリックして拡大)

【図1】https://c2pa.org/specifications/specifications/2.1/specs/C2PA_Specification.htmlより

コンテンツそのものと、それに付随するメタデータに加え、複数の「Manifest」と呼ばれるデータが付加されます。これを総称してProvenance(来歴)データと呼びます。

Manifestはコンテンツが生成・編集されるたびに追加され、これを辿ることで来歴を追跡できます。

個々のManifestデータの詳細について見ていきましょう。(クリックして拡大)

Manifestは大きく「Assertion」と「Claim」、そして「Claim Signature」に分けられます。Claim SignatureはClaimに対する電子署名です。

撮影や編集に関わる個々のメタデータや画像のサムネイルなどは「Assertion」と呼ばれます。このAssertionを構造体として示したものが「Claim」で、Claim Generatorと呼ばれるコンテンツを生成または編集するハードウェアやソフトウェアによって作成されます。

このClaimに電子署名を行うことで、Claim中のデータの非改ざん性が保証されます。

AIで生成した画像の検証

実際にAIで画像を生成し、その画像をCAIが提供する検証ツールで確認してみましょう。

画像生成には、OpenAIがC2PA使用への対応を発表しているDALL·EをChatGPT経由で使用します。

【図3】生成した画像

この画像を、CAIが提供しているVerifyツールで検証してみましょう。(クリックして拡大)

【図4】Verifyツールで検証した結果

ChatGPT経由でDALL·Eを使用した場合、DALL·Eで画像生成した際のオリジナルのManifestと、ChatGPTから最終的に出力する際の追加のManifestの2種類が付加されていることが確認できます。

オリジナルのManifestの「コンテンツの概要」には、「このコンテンツはAIツールで生成されました」と記載されており、使用されたAIツールとして「DALL·E」が明確に示されています。このことから、DALL·Eによって生成された画像であることが判別可能です。

電子署名におけるトラストアンカー

Claim Generatorは電子署名を施すために秘密鍵と公開鍵の鍵ペア、および公開鍵証明書を保持します。

電子署名の検証者は、この公開鍵証明書を用いて署名を検証することで、署名者であるClaim Generatorの「身元」と署名の正当性を確認できます。

現在、その証明書自体の信頼性をどのように担保するのかという、「トラストアンカー」の概念については、検証者に一任されている状態です。

例えば、CAIのVerifyツールでは、「信頼できる証明書のリスト」や「信頼できる認証局のリスト」を保持し、公開しています(これらのリストは適宜更新されています)。

また、C2PAのContent Credentialsの技術仕様には、C2PAが管理するトラストアンカーのリストである「C2PA Trust List」の存在が明記されています。現在はその要件について議論中で、実現には時間がかかる見込みですが、将来的には「C2PA Trust List」と検証者独自のリストを組み合わせて運用されると考えられます。

最後に

フェイク画像やフェイク動画、フェイクニュースが社会問題となる中で、これに対抗するためのさまざまな取り組みが世界中で行われています。

今回紹介したC2PAの取り組みは、参加企業の顔ぶれを見ても、グローバルでのデファクトスタンダードになる可能性が非常に高いと考えられます。

詳細な仕様についてはまだ議論が続いており、今後の動向から目が離せません。